Não importa o campo de conhecimento: o ponto de partida para lidar com a nova era digital inaugurada pela inteligência artificial (IA) deve ser o entendimento de que ela não é apenas uma ferramenta ou instrumento. É preciso reconhecê-la como uma Tecnologia de Propósito Geral (TPG), ou seja, uma tecnologia capaz de transformar estruturalmente o modo como produzimos, inovamos, compartilhamos conhecimento e geramos memória coletiva. Ao lado dela, estão, por exemplo, revoluções como a criação da máquina a vapor e da eletricidade.

A inteligência artificial pode ser uma das maiores oportunidades do nosso tempo para promovermos desenvolvimento com melhoria da produtividade e conquista da equidade. Se bem orientada, com ética, intencionalidade pública e compromisso com a justiça social e o desenvolvimento econômico, ela nos permite reimaginar sistemas antes aprisionados pela escassez de tempo, recursos ou acesso, além de nos reorganizarmos como humanidade no planeta.

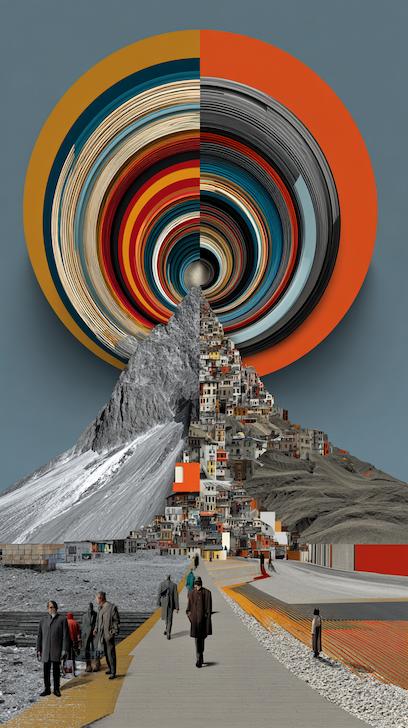

Como toda TPG, as IAs, principalmente em sua modalidade generativa, têm impacto transversal, contínuo e sistêmico. Exigem novas arquiteturas institucionais e novos modos de conduzir a existência. As consequências são tão profundas que nos obrigam a revisitar e reivindicar questões epistemológicas (sobre como conhecemos) e, sobretudo, ontológicas – não apenas sobre como percebemos o mundo, mas sobre o próprio estatuto do que pode ou não ser considerado parte do humano. Isso abre um novo e inescapável debate que precisamos enfrentar: o do Direito à Realidade.

O conceito pode ser explicado como o direito a uma percepção não distorcida e autêntica da realidade, o que inclui a transparência sobre conteúdos manipulados digitalmente, a preservação da integridade da experiência subjetiva, a oportunidade da convivência e da coexistência e a constituição de saberes críticos, analíticos, adaptativos e criativos, que ampliem nossa capacidade de discernir, imaginar e questionar – não apenas absorver o que nos é servido.

A questão é tão essencial que deveria estar presente na regulação das IAs para assegurar a integridade de dados, informações, valores, práticas e signos, e até mesmo a transmissão de conhecimento entre gerações, o que ainda está longe de acontecer.

Para entendermos melhor o Direito à Realidade, é preciso primeiro pensarmos sobre o que é real. O cérebro humano, como sabemos pela neurociência, interpreta estímulos com base em padrões e experiências, não necessariamente em sua origem. Uma imagem artificial pode ser recebida com a mesma intensidade emocional que uma experiência autêntica. Ou seja, mesmo sabendo que algo é fabricado, nosso organismo reage como se fosse real – ainda mais diante daquilo que nem sequer sabemos que não existiu.

Com o avanço das ferramentas de inteligência artificial generativa, esse contexto ganha ainda mais relevância e precisamos de novos conceitos para dar conta do desafio. Um deles é a distinção entre dados históricos e sintéticos. Sua diferenciação está na origem: enquanto os dados históricos são gerados a partir da interação entre pessoas ou por sensores, os dados sintéticos são produzidos por modelos de IA. Discussões éticas acerca dos conteúdos sintéticos começam a repercutir, envolvendo questões como autenticidade, propriedade intelectual, privacidade, deep fakes e vieses.

Ainda não há um consenso sobre até que ponto o uso da IA torna determinado conteúdo sintético, porém já se sabe que o uso desses dados para o treinamento de modelos de IA pode trazer resultados alarmantes. É o fenômeno chamado de “loop de feedback”, em que pequenos erros nos dados sintéticos vão sendo amplificados a cada nova versão gerada a partir deles, em um verdadeiro telefone sem fio de erros. Esse efeito é ainda mais preocupante quando pensamos que a internet está inundada por dados sintéticos, que, segundo especialistas, já representam mais da metade do conteúdo na rede. É aqui que emerge o que chamo de Desigualdade Sintética.

Trata-se de uma desigualdade que não é apenas material, nem puramente informacional, mas que opera nos planos simbólico, epistêmico e perceptivo. Trata-se da diferença entre aqueles que conseguem experienciar o mundo de forma encarnada – com presença, corpo e vínculos – e aqueles cuja experiência é cada vez mais mediada por telas, dados e simulações. Essa desigualdade não decorre simplesmente da ausência ou presença de dispositivos ou de conectividade, mas de um processo mais profundo: o modo como a realidade é codificada sob a ótica da nossa consciência e, a partir disso, mediada e apresentada a diferentes grupos sociais.

A IA nos obriga a revisitar as fronteiras do que é propriamente humano e abre espaço para uma autorreflexão civilizatória. Se a IA simula linguagem, arte, decisão e até empatia, o que resta como essencialmente humano? Talvez seja a capacidade de atribuir sentido, deliberar com responsabilidade, relacionar-se com alteridade profunda

A aceleração da inteligência artificial e a explosão de conteúdos sintéticos criam o risco de que parcelas significativas da população sejam empurradas para uma realidade de segunda ordem, fragmentada, algorítmica e, por vezes, ilusória. É uma exclusão que opera na aparência da inclusão. Universaliza-se o acesso digital, mas sem garantir o Direito à Realidade, ou seja, o acesso ao mundo compartilhado, verificável e vivido. A consequência é uma vida reduzida à simulação, em que vínculos, afetos e até mesmo a experiência do aprendizado se dão em ambientes mediados por plataformas que prometem neutralidade, mas carregam vieses, opacidades e padrões de homogeneização.

Essa desigualdade se manifesta, por exemplo, na formação de professores. Garantir vivência prática nas licenciaturas não é apenas uma questão pedagógica: é uma questão de equidade e de compromisso com o real. Quando a formação docente prescinde do chão da escola, da escuta ativa, do encontro com o outro e da imprevisibilidade do cotidiano educacional, ela se converte numa simulação. Uma formação que deveria ser experiência encarnada se torna avatar de si mesma. Nesse cenário, a Desigualdade Sintética se coloca como um dos importantes desafios contemporâneos para a justiça educacional.

A ênfase na plataformização também é marcada por desigualdade. Quando uma criança aprende apenas por meio de telas, sem mediação sensível, enquanto outra explora o mundo com os cinco sentidos e sem medos, há uma privação concreta da experiência. Trata-se de uma assimetria ontológica: modos completamente distintos de se estar no mundo e de se relacionar com a realidade.

Retomo aqui a raiz da palavra informação: informare, que em latim significa “dar forma a algo”. O filósofo italiano Luciano Floridi, em The onlife manifesto, sustenta que vivemos numa realidade tecnossimbólica, onde a distinção entre online e offline já não faz sentido. O ser humano vive “onlife”, imerso num ambiente em que dados, imagens e mediações digitais moldam a percepção e a ação. Nesse ecossistema, quem não tem discernimento, agência ou capacidade crítica está, de fato, excluído da realidade. Trata-se de uma exclusão ontológica, e não apenas digital. Como o próprio Floridi afirma: se a informação molda o real, então o acesso a ela precisa ser regulado por critérios de justiça, confiabilidade e pluralidade. Nem toda informação se transforma em conhecimento. E é aí que entra a necessidade de uma interpretação crítica que resgate o sentido, o contexto e a ética da mediação.

A Desigualdade Sintética também nos obriga a enfrentar um dilema novo: se a IA pode simular dor, afeto, consciência ou ética – sem jamais senti-los –, que tipo de mundo estamos construindo? Ao criar sistemas que encenam humanidade sem humanidade, corremos o risco de anestesiar nossa própria sensibilidade. No limite, como venho defendendo, corremos o risco de perder o próprio chão da realidade. É nesse sentido que a Desigualdade Sintética amplia as desigualdades já existentes e inaugura outras, invisíveis às métricas convencionais.

Autores como Abhijit Banerjee e Esther Duflo, ambos laureados com o Prêmio Nobel de Economia, nos lembram que o combate à desigualdade exige ir além dos grandes modelos. Exige escuta, contexto, realidade concreta. É esse o espírito que inspira este ensaio. Não se trata apenas de fornecer tablets, algoritmos ou conectividade, mas de garantir a presença social, o corpo participativo e o vínculo humano. Por isso defendo que a atuação contra a Desigualdade Sintética passa pela afirmação de dois princípios ético-políticos: a interdependência, como condição relacional e corresponsável entre sujeitos, e o Direito à Realidade, como garantia de que ninguém seja empurrado a viver quase que exclusivamente apenas à sombra digital do mundo.

Nesse sentido, reafirmar a importância da vida vivida é também uma forma de resistência. A coexistência, o encontro entre diferentes, a potência do território – com suas ruas, praças, igrejas, bibliotecas, escolas e famílias – constituem espaços de equidade concreta. O virtual é sim fundamental para expandirmos nossa presença no mundo, mas se torna nefasto quando se apresenta como única opção, esvaziando a experiência corpórea, relacional e imprevisível do convívio. O habitat do encontro e da natureza não é um luxo nostálgico. É um imperativo ético em tempos de hiperconexão desigual. Defender o espaço público, o afeto situado, a escola como lugar de vínculo e a comunidade, junto à família, como elo de pertencimento é assegurar que ninguém seja condenado à existência sintética, sem natureza, sem corpo, sem outro.

A imprescindível experiência do real

E nesses espaços que cultivamos o que chamo de Direito à Realidade: a possibilidade de viver com densidade, vínculo e atuação, em contraponto àqueles que, privados dessas âncoras, são empurrados para o isolamento, a insegurança e o refúgio precário no virtual.

É evidente que o virtual e o sintético desempenham um papel fundamental, pois democratizam o acesso e impulsionam o avanço do conhecimento. Também possibilitam novas descobertas e inovações significativas no mundo científico. Mas não podem ser experiências preponderantes para as pessoas.

Essa força ambígua diz muito de como vejo a IA: uma TPG que nos confronta com riscos profundos, mas também com a possibilidade de regeneração. O que faremos com essa caixa de Pandora aberta depende de nós, das escolhas políticas, institucionais e éticas que formos capazes de fazer em nome do bem comum. E, para isso, precisamos ter a máxima consciência do que essa nova força que se apresenta pode significar para a humanidade.

Nesse ponto, vale recorrer ao sociólogo francês Émile Durkheim, cuja obra é fundamental para refletirmos sobre os efeitos sociais dessa tecnologia. Durkheim concebe a educação como um processo coletivo de integração e solidariedade, e a cultura como um vetor de coesão social. Sua noção de “fato social” – comportamentos, normas e expectativas que moldam os indivíduos de forma coercitiva, muitas vezes sem mediação crítica – é central para compreendermos como a transformação digital que vivemos torna certas condutas normativas, influenciando decisões, percepções e formas de vida. Ao pensarmos a IA como fato social, somos convocados a interrogar não apenas sua funcionalidade, mas sua força simbólica: o que ela impõe, o que oculta, o que torna desejável ou inviável.

Durkheim também nos oferece uma chave importante ao distinguir entre solidariedade mecânica (baseada na semelhança entre indivíduos) e solidariedade orgânica (baseada na interdependência entre diferentes). Esse conceito é especialmente potente no momento em que transitamos de um mundo do trabalho tradicional para um mundo ancorado em redes criativas, cognitivas e tecnológicas. Sua preocupação com a coesão, sobretudo diante das rupturas provocadas por inovações, reforça a centralidade da educação e da cultura emanadas, vividas, como condições para que possamos fazer da IA uma aliada do bem comum, e não um vetor de exclusão silenciosa.

É nesse contexto que o Direito à Realidade se impõe como um novo capítulo dos Direitos Humanos. Um direito que não é apenas informacional, mas também simbólico e existencial. É aqui também que a Ética Relacional precisa se afirmar. A ética que nasce do encontro, como nos lembra o filósofo austríaco Martin Buber: do “entre” que se constrói entre o Eu e o Tu. Da presença, do toque, da escuta e da hesitação. Não estamos falando apenas de regulação tecnológica. Estamos falando de reparar a confiança no mundo compartilhado.

Por isso insisto: precisamos ressignificar e fortalecer as escolas, os museus, as igrejas, as bibliotecas, as praças e a natureza, como territórios de convivência, onde vínculos se constroem a partir da vida vivida, e não de narrativas programadas. Porque é por meio desse exercício consciente que poderemos sustentar um mundo capaz de resistir ao dilúvio sintético. Um mundo do encontro, da convivência, da coexistência.

Pois é no real, com sua densidade, seus riscos e seus sentidos, que seguimos sendo humanos. Não apenas pelo controle das máquinas, mas pela fidelidade à experiência que nos transforma. Pela capacidade de comoção diante da subjetividade da arte, ou mesmo da fé, e da busca pela plenitude incompleta do ser. Aí, sim, a reafirmação do humano.

A potência dos encontros no real

IMPOSSÍVEL NÃO LEMBRAR DO FILME MATRIX, de 1999, dirigido por Lilly e Lana Wachowski, que explora profundamente a questão da realidade. O personagem principal, Neo, descobre que o mundo em que vive é uma simulação gerada por máquinas inteligentes que controlam a humanidade. Neo é confrontado com a escolha de continuar vivendo na ilusão ou enfrentar a realidade.

Matrix nos força a questionar: o que é real? Se não tivermos garantias, ferramentas e interações éticas para distinguir a realidade do Simulacro e Simulação – não à toa, o livro do filósofo francês Jean Beaudrillard aparece de forma subliminar no filme –, poderemos ser manipulados, rodeados por nossa ignorância e complacência.

O Direito à Realidade precisa ser um tema para debate e mobilização de todos – governos, instituições multilaterais, academia, empresas e sociedade civil –, abordado como um novo campo dos Direitos Humanos, em especial o artigo primeiro, que fala de liberdade, razão, consciência e fraternidade.

A saída, para além da regulamentação e de imperativos éticos no design e na implementação da IA, passa necessariamente pela aliança transformadora da arte, da cultura e da educação, e pela potência dos encontros no real. Essa tríplice (arte, cultura e educação) possibilita o desenvolvimento de quatro importantíssimas habilidades que precisam nos guiar, mais do que nunca, no cenário contemporâneo: a adaptabilidade e os pensamentos crítico, analítico e criativo.

Somente se estivermos munidos dessas quatro habilidades, e focados na potência que a interdependência nos traz, teremos o componente humano no centro dessa revolução tecnológica que pode, e deve, nos trazer grandes oportunidades para um novo capítulo da história da humanidade.

IA para todos

As possibilidades são inúmeras e dependem de nossa intencionalidade como mundo, nação, organizações, sociedade e família. E também, sob o ponto de vista ontológico, todo o debate que a IA provoca nos oferece grandes oportunidades, como a redefinição do humano. A IA nos obriga a revisitar as fronteiras do que é propriamente humano e abre espaço para uma autorreflexão civilizatória. Se a IA simula linguagem, arte, decisão e até empatia, o que resta como essencialmente humano? Talvez seja a capacidade de atribuir sentido, deliberar com responsabilidade, relacionar-se com alteridade profunda, ou seja, desenvolver aquilo que Martin Buber chamaria de uma ética do “Eu-Tu”, e não apenas do “Eu-Isso”. É ontologicamente promissor porque nos força a sair da fantasia da autonomia e autossuficiência como paradigma e reencontrar o humano como ser relacional, presente, simbólico e finito.

Essa mesma IA nos oferece a oportunidade de ampliação do campo do pensável e do dizível. A IA nos dá acesso a formas de expressão, linguagem e articulação antes inimagináveis. A IA generativa pode nos oferecer melhor e maior tecnologia para fabulação humana, ao reconhecermos que essa é uma condição de vida, como dizia o crítico literário Antonio Candido em seu texto seminal de 1988 sobre o direito à literatura. E nisso: criar narrativas simbólicas, simular cenários futuros, explorar caminhos que ampliam a imaginação para novos cenários e tempos possíveis.

Nesse caso, a IA não reduz a realidade, ela a multiplica, desde que estejamos conscientes de que são simulações, não substituições. Aqui está o elo com meu conceito de Direito à Realidade: garantir o acesso ao real não significa recusar a simulação, mas distingui-la e integrá-la com compreensão simbiótica.

Temos a chance de instituir uma ética tecnológica relacional: a realidade é tecida por relações – entre humanos, e entre humanos conscientes que interagem com o não humano. A governança da IA passa a ser um campo onde a técnica não é neutra, mas ética em sua origem. A supervisão humana torna-se um gesto essencial e fundador.

Como aponta Ailton Krenak, o nosso tempo é especialista em criar ausências: do sentido de viver em sociedade, do próprio sentido da experiência da vida. Isso gera uma intolerância muito grande em relação a quem ainda é capaz de experimentar o prazer de estar vivo, de dançar, de cantar.

Vivemos um laboratório vivo do nosso tempo. Isso significa renovar os vínculos da interdependência e instituir um novo pacto no qual a consciência permanece nos fazendo no e para o mundo.

Em tempos de acelerada transformação, precisamos reafirmar que o digital não pode ser a única forma de existência possível. A IA precisa expandir nossa presença e conhecimento, mas jamais substituir a convivência e os saberes. É por isso que sigo defendendo o Direito à Realidade, a ética da interdependência e o enfrentamento da Desigualdade Sintética. Mas faço isso com os olhos firmes naquilo que resta no fundo da caixa de Pandora: a esperança.

A inteligência artificial não é destino. É escolha. E pode ser, sim, uma escolha de futuro para todos.